Dunia teknologi telah menerima sensasi baru - GPT-3.

Model bahasa besar (seperti GPT-3) semakin mengejutkan kami dengan kemampuannya. Sementara kepercayaan bisnis pada mereka belum cukup untuk mempresentasikannya kepada pelanggan mereka, model ini menunjukkan permulaan dari kecerdasan yang akan mempercepat pengembangan otomatisasi dan kemampuan sistem komputasi "pintar". Mari kita keluarkan aura misteri dari GPT-3 dan cari tahu bagaimana ia belajar dan cara kerjanya.

Model bahasa yang terlatih menghasilkan teks. Kami juga dapat mengirim beberapa teks ke input model dan melihat bagaimana output berubah. Yang terakhir ini dihasilkan dari apa yang telah "dipelajari" model selama periode pelatihan dengan menganalisis teks dalam jumlah besar.

Pembelajaran adalah proses mentransfer sejumlah besar teks ke model. Untuk GPT-3, proses ini selesai dan semua eksperimen yang Anda lihat berjalan pada model yang sudah dilatih. Diperkirakan bahwa pelatihan akan memakan waktu 355 tahun GPU (355 tahun pelatihan pada satu kartu grafis) dan biaya $ 4,6 juta.

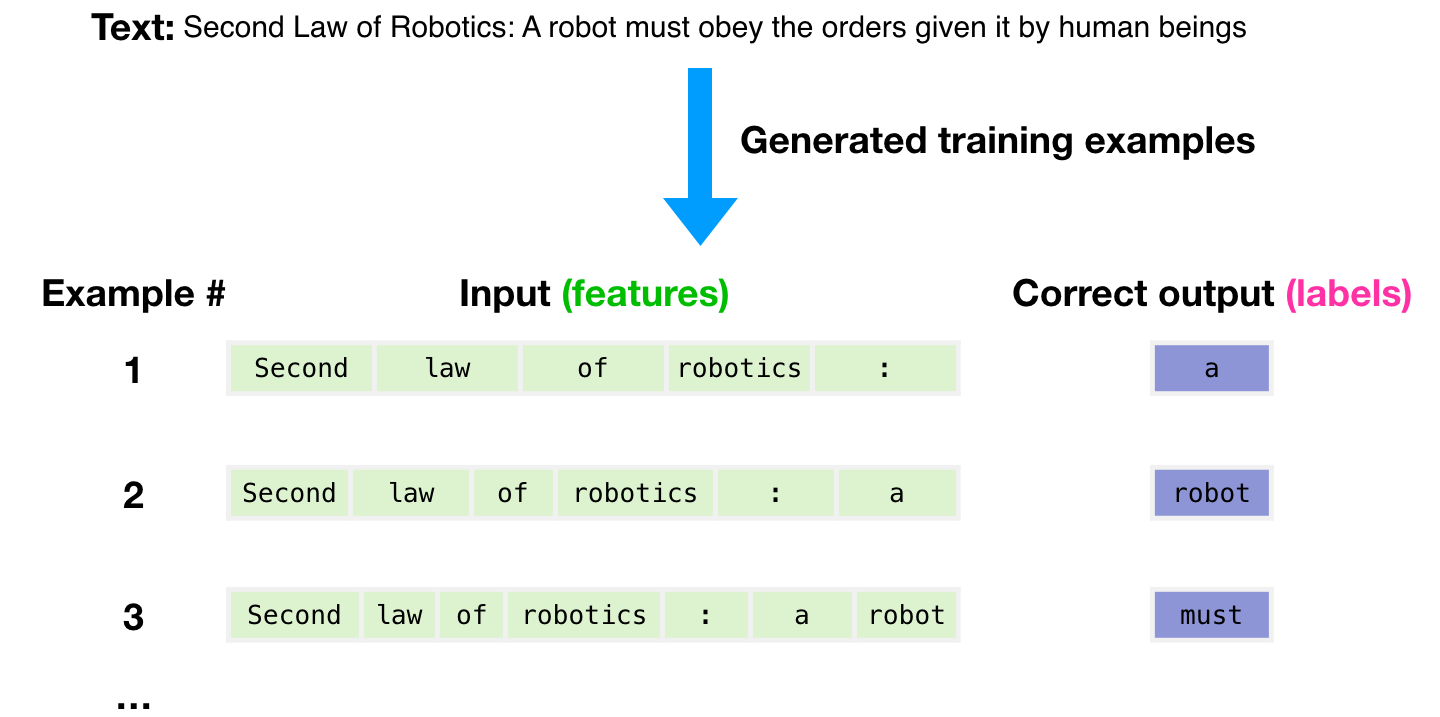

Kumpulan data 300 miliar token teks digunakan untuk menghasilkan contoh untuk melatih model. Misalnya, seperti inilah tampilan tiga contoh pelatihan, yang diturunkan dari satu kalimat di atas.

, , .

( ) .

. , .

.

.

GPT-3 ( , – ).

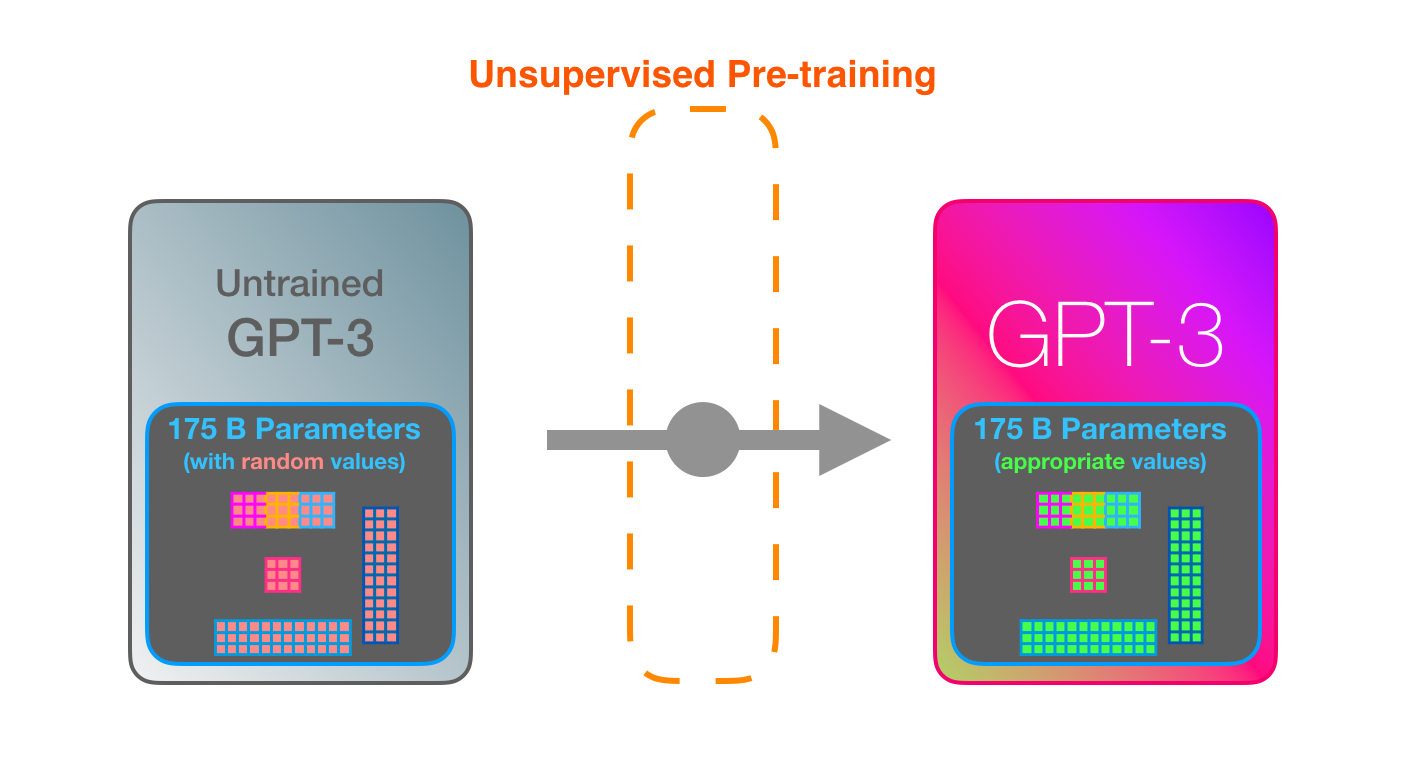

GPT-3 . , , 175 ( ). .

, , .

– , – , .

« Youtube» – 175- .

, , .

GPT-3 2048 – « », 2048 , .

. «robotics» «A»?

:

- ( ).

- .

- .

GPT-3 96 .

? «» « » (deep learning).

1.8 . «». :

, , GTP-2 .

GPT-3 (dense) (sparse) (self-attention).

«Okay human» GPT-3. , . : , . .

React ( ), , => . React , , .

Dapat diasumsikan bahwa contoh dan deskripsi awal telah ditambahkan ke input model, bersama dengan token khusus yang memisahkan contoh dari hasil.

Cara kerjanya sangat mengesankan. Anda hanya perlu menunggu penyempurnaan GPT-3 selesai. Dan kemungkinannya akan lebih menakjubkan.

Tweaking hanya memperbarui bobot model untuk meningkatkan kinerjanya untuk tugas tertentu.

Penulis

- Penulis asli - Jay Alammar

- Terjemahan - Ekaterina Smirnova

- Pengeditan dan tata letak - Sergey Shkarin