Revolusi kecerdasan buatan modern dimulai dengan kompetisi penelitian rahasia. Ini terjadi pada tahun 2012, tahun ketiga kompetisi ImageNet. Tantangan bagi tim adalah membangun solusi yang akan mengenali ribuan gambar, dari hewan dan manusia hingga lanskap.

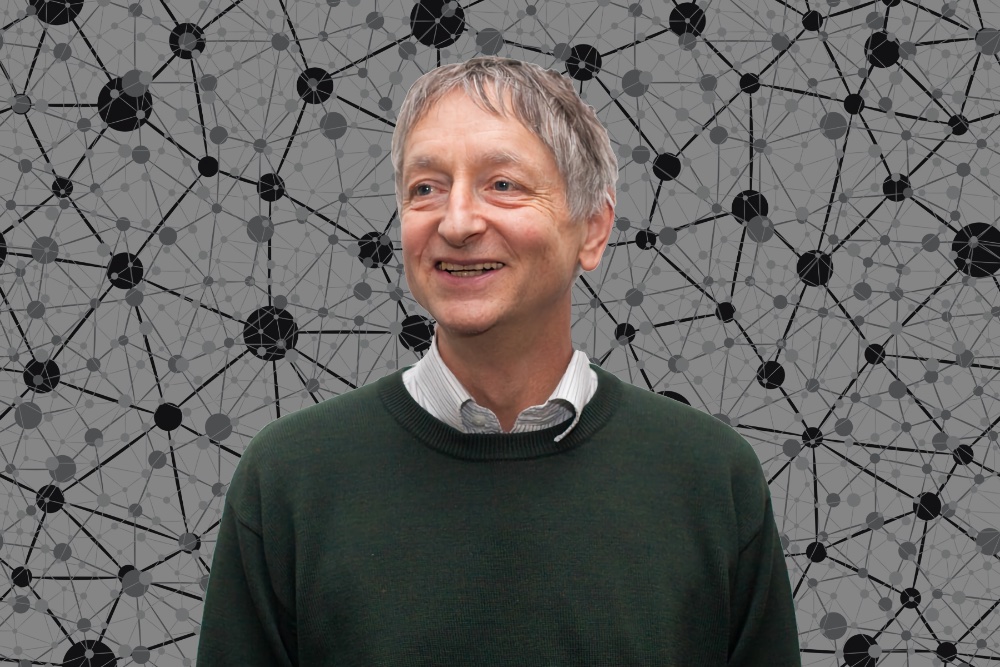

Dalam dua tahun pertama, tim teratas tidak mencapai akurasi lebih dari 75%. Pada tahun ketiga, tim peneliti - seorang profesor dan mahasiswanya - tiba-tiba menerobos langit-langit itu. Mereka memenangkan kompetisi dengan mengejutkan 10,8%. Nama profesor itu adalah Geoffrey Hinton, dan metodenya adalah pembelajaran yang mendalam.

Hinton telah bekerja dengan pembelajaran mendalam sejak 1980-an, tetapi efisiensi dibatasi oleh kurangnya data dan daya komputasi. Keyakinannya yang teguh pada metode tersebut akhirnya membuahkan hasil yang sangat besar. Pada tahun keempat kompetisi, hampir setiap tim menerapkan pembelajaran mendalam, mencapai hasil yang menakjubkan dalam akurasi. Dalam waktu singkat, pembelajaran mendalam mulai diterapkan di berbagai industri, dan tidak hanya dalam tugas pengenalan gambar.

Tahun lalu, Hinton, bersama dengan perintis kecerdasan buatan Jan Lecun dan Joshua Bengio, dianugerahi Hadiah Turing untuk Kontribusi Dasar untuk bidang sains ini.

Menurut Anda, pembelajaran mendalam akan cukup untuk mereplikasi semua kecerdasan manusia. Apa yang membuatmu begitu percaya diri?

Saya percaya bahwa pembelajaran mendalam dapat melakukan segalanya, tetapi saya pikir pasti ada beberapa terobosan konseptual. Misalnya, pada tahun 2017, Ashish Vaswani dan rekan-rekannya memperkenalkan transformer yang menghasilkan vektor yang sangat bagus yang mewakili makna kata. Itu adalah terobosan konseptual. Sekarang digunakan di hampir semua pemrosesan bahasa alami terbaik. Kami akan membutuhkan banyak terobosan seperti itu.

Dan jika kita memiliki terobosan seperti itu, akankah kita membawa kecerdasan buatan lebih dekat ke kecerdasan manusia menggunakan pembelajaran yang mendalam?

Iya. Terutama terobosan yang terkait dengan cara Anda mendapatkan aktivitas saraf vektor besar untuk mengimplementasikan hal-hal seperti berpikir. Tapi kami juga butuh skala besar. Otak manusia memiliki sekitar seratus triliun parameter atau sinapsis. Model yang sangat besar sekarang kita sebut GPT-3 dengan 175 miliar parameter. Ini seribu kali lebih kecil dari otak. GPT-3 sekarang dapat menghasilkan teks yang cukup dipercaya, tetapi masih kecil dibandingkan dengan otak.

Saat Anda berbicara tentang skala, yang Anda maksud adalah jaringan neural besar, data, atau keduanya?

Kedua. Ada ketidaksesuaian antara apa yang terjadi dalam ilmu komputer dan apa yang terjadi pada manusia. Orang-orang memiliki banyak sekali parameter dibandingkan dengan jumlah data yang mereka terima. Jaringan saraf bekerja sangat baik dengan lebih sedikit data dan lebih banyak parameter, tetapi manusia bahkan lebih baik.

Banyak ahli AI percaya bahwa kecerdasan AI adalah kemampuan yang perlu dikejar lebih jauh. Apa kamu setuju?

Saya setuju bahwa ini adalah salah satu hal terpenting. Saya juga berpikir kontrol gerakan sangat penting, dan jaringan pembelajaran yang mendalam semakin mahir melakukannya hari ini. Secara khusus, beberapa pekerjaan baru-baru ini oleh Google telah menunjukkan bahwa dimungkinkan untuk menggabungkan keterampilan motorik halus dan ucapan sedemikian rupa sehingga sistem dapat membuka laci meja, melepaskan balok, dan memberi tahu dalam bahasa alami apa yang telah dilakukannya.

Untuk hal-hal seperti GPT-3, yang menghasilkan teks yang bagus, jelas bahwa ia harus banyak memahami untuk menghasilkan teks, tetapi tidak begitu jelas seberapa banyak ia memahaminya. Tetapi ketika sesuatu membuka laci, mengeluarkan balok dan berkata, “Saya baru saja membuka laci dan mengeluarkan balok,” sulit untuk mengatakan bahwa ia tidak mengerti apa yang dilakukannya.

Pakar AI selalu memandang otak manusia sebagai sumber inspirasi yang tidak ada habisnya, dan pendekatan yang berbeda terhadap AI berasal dari berbagai teori ilmu kognitif. Apakah menurut Anda otak benar-benar membangun pandangan dunia untuk memahaminya, atau apakah itu hanya cara berpikir yang berguna?

Dalam ilmu kognitif, telah lama terjadi perdebatan antara kedua aliran pemikiran tersebut. Pemimpin sekolah pertama, Stephen Kosslin, percaya bahwa ketika otak beroperasi dengan gambar visual, kita berbicara tentang piksel dan gerakannya. Sekolah kedua lebih sejalan dengan AI tradisional. Penganutnya berkata: “Tidak, tidak, ini tidak masuk akal. Ini adalah deskripsi hierarkis dan struktural. Pikiran memiliki struktur simbolis tertentu, kita mengontrol struktur ini. "

Saya pikir kedua sekolah melakukan kesalahan yang sama. Kosslin mengira kami memanipulasi piksel karena gambar eksternal terdiri dari piksel dan piksel adalah representasi yang kami pahami. Aliran kedua berpikir bahwa karena kita memanipulasi representasi simbolik dan merepresentasikan sesuatu melalui simbol, maka representasi simboliklah yang kita pahami. Saya pikir kesalahan ini setara. Di dalam otak terdapat vektor besar aktivitas saraf.

Ada orang yang masih percaya bahwa representasi simbolik adalah salah satu pendekatan AI.

Benar. Saya memiliki teman baik, seperti Hector Levesque, yang sangat percaya pada pendekatan simbolik dan telah melakukan pekerjaan yang hebat dalam hal ini. Saya tidak setuju dengannya, tetapi pendekatan simbolik adalah hal yang masuk akal untuk dicoba. Namun, saya pikir pada akhirnya kita menyadari bahwa simbol hanya ada di dunia luar, dan kita melakukan operasi internal pada vektor besar.

Pandangan apa tentang AI yang menurut Anda paling berlawanan dalam hubungannya dengan orang lain?

Nah, masalah saya adalah saya memiliki pandangan yang berlawanan, dan setelah lima tahun mereka menjadi arus utama. Kebanyakan pandangan berlawanan saya dari tahun 1980-an sekarang diterima secara luas. Sekarang cukup sulit untuk menemukan orang yang tidak sependapat dengan mereka. Jadi ya, pandangan saya yang berlawanan dirusak dalam beberapa hal.

Siapa tahu, mungkin pandangan dan metode Anda bekerja dengan AI juga akan berada di bawah tanah, dan dalam beberapa tahun akan menjadi standar industri. Hal utama adalah jangan berhenti dalam kemajuan Anda. Dan kami akan dengan senang hati membantu Anda dengan menghadirkan kode promo khusus HABR , yang akan menambah 10% diskon pada spanduk.

- Kursus Lanjutan "Machine Learning Pro + Deep Learning"

- Kursus "Matematika dan Pembelajaran Mesin untuk Ilmu Data"

- Kursus Machine Learning

- Pelatihan profesi Ilmu Data

- Data Analyst

- - Data Analytics