Penulis: Eugenio Culurciello, judul asli: Kejatuhan RNN / LSTM

Terjemahan: Davydov A.N.

Kami menyukai RNN (Recurrent Neural Networks), LSTM (Long-short term memory), dan semua variannya. Dan sekarang saatnya untuk menyerahkan mereka!

Pada tahun 2014, LSTM dan RNN dibangkitkan. Tapi kami masih muda dan tidak berpengalaman. Selama beberapa tahun mereka telah menjadi cara untuk memecahkan masalah seperti pembelajaran sekuensial, terjemahan urutan (seq2seq). Mereka juga memungkinkan untuk mencapai hasil yang luar biasa dalam memahami ucapan dan menerjemahkannya ke dalam teks. Jaringan ini telah memicu munculnya asisten suara seperti Siri, Cortana, Google, dan Alexa. Jangan lupakan terjemahan mesin, yang memungkinkan kami menerjemahkan dokumen ke berbagai bahasa. Atau terjemahan mesin jaringan saraf, yang memungkinkan Anda menerjemahkan gambar ke teks, teks ke gambar, membuat subtitle untuk video, dll.

Kemudian, pada tahun-tahun berikutnya (2015-16), ResNet dan Attention muncul. Kemudian pemahaman mulai muncul bahwa LSTM adalah teknik yang cerdik untuk mem-bypass, bukan memecahkan suatu masalah. Perhatian juga menunjukkan bahwa jaringan MLP (Multi-Layer Perceptron Neural Networks) dapat digantikan oleh jaringan rata-rata yang digerakkan oleh vektor konteks. (lebih lanjut tentang ini nanti).

Hanya 2 tahun telah berlalu, dan hari ini kita dapat mengatakan dengan pasti:

"Knock up dengan RNN dan LSTM, mereka tidak sebagus itu!"

, , Attention , , . RNN Attention . RNN , , Attention.

?

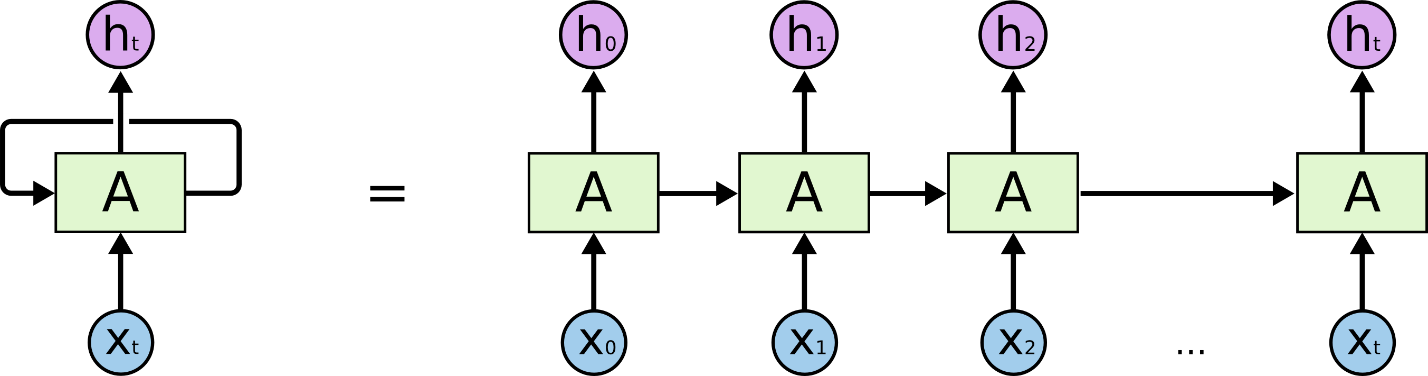

, RNN, LSTM . :

, , . , , 0, .

LSTM. , , ResNet. () . LSTM . .

. , , . , LSTM, GRU ! (100), .

RNN , . , ( ), . RNN . , , , Amazon Echo!

?

2D , RNN/LSTM, Attention, Transformer

Transformer 2017 , . , .

: , , « » , « », - ( ) , , . , / .

« », , :

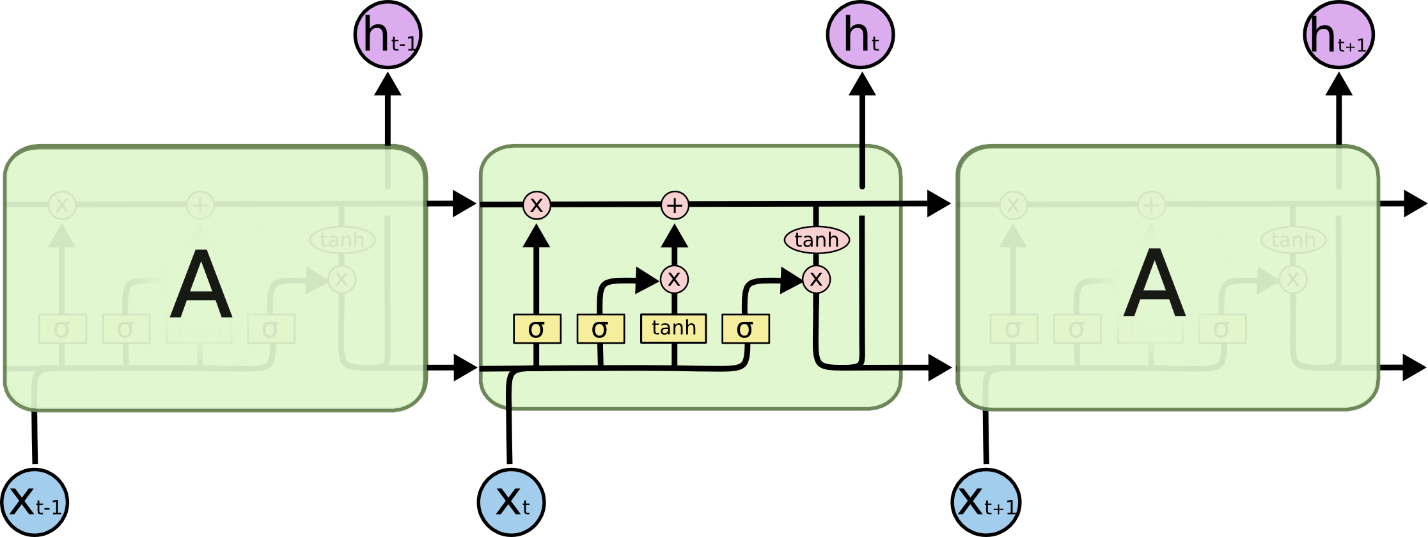

- , Ct

, , . (TCN), 3 .

«» , 100 , 100 «» 100 . 100100 . 10 000 .

, .

, , , : , N (log(N)), N – . , RNN, – . T N (T>>N)

, 3-4 100!

, , «». , , .

? , . , , : , – , . , , . , . , , , .

– RNN . Attention. , - , !

RNN\LSTM: RNN LSTM , , . , LSTM 4 ( MLP) . , , . , ( , . .). RNN / LSTM , . , , FWDNXT.

1: WaveNet. . : .

2: RNN LSTM - ( . ). () , / , ! , - . - , ( ).

3: , CNN RNN. (TCN) « , LSTM, , ».

4: , , . « , , 858 534 22 30, . , »- , «» (Attention), , , (TCN). , RNN, , . , (, 5 ), , , , .

5: , , , . «» . , ! !

6: Attention Transformer, . VGG NLP? , LSTM , . LSTM Transformer ( ), , , « LSTM Transformer - MRPC »