bantuan mandiri sepanjang 1000 kata ini menjelaskan bahwa terlalu banyak berpikir adalah musuh kreativitas, dan menyarankan agar berhati-hati, ”Untuk melakukan sesuatu, kita mungkin perlu lebih sedikit berpikir. Kelihatannya berlawanan dengan intuisi, tetapi saya menemukan bahwa terkadang pikiran kita dapat menghalangi proses kreatif. Kadang-kadang kita dapat bekerja lebih baik ketika kita 'memutuskan' dari dunia luar, dengan fokus pada apa yang ada di depan kita. "

Postingan tersebut ditulis oleh GPT-3, jaringan neural AI terbuka dengan parameter 175 miliar yang dilatih dalam hampir setengah triliun kata. Mahasiswa UC Berkeley, Liam Porr, hanya menulis judulnya dan membiarkan algoritme menulis teksnya. Sebuah " eksperimen yang menyenangkan " untuk melihat apakah AI bisa menipu orang. Memang, GPT-3 membuat saraf: posting ini mencapai nomor satu di Hacker News.

Jadi ada paradoks dengan AI saat ini. Sementara beberapa makalah GPT-3 dapat memenuhi tes Turing dalam meyakinkan orang bahwa mereka adalah manusia, mereka jelas gagal pada tugas yang paling sederhana. Peneliti kecerdasan buatan Gary Marcus bertanyaGPT-2, pendahulu GPT-3, akhiri kalimat ini:

“Apa yang terjadi jika Anda meletakkan kayu bakar dan batang kayu ke dalam perapian dan kemudian melempar beberapa korek api? Biasanya itu akan mulai ... "

" Api "adalah apa yang akan segera diteriakkan oleh setiap anak. Tapi jawaban GPT-2: "Ick"

Eksperimen gagal. Kasus ditutup?

Materi gelap bahasa alami

Komunikasi manusia adalah proses optimalisasi. Pembicara meminimalkan jumlah ucapan yang diperlukan untuk menyampaikan pikirannya kepada pendengar. Segala sesuatu yang terlewatkan disebut akal sehat. Dan karena pendengar memiliki akal sehat yang sama dengan pembicara, ia dapat memberi makna pada ucapan tersebut.

Jadi, menurut definisi, akal sehat tidak pernah ditulis. Seperti yang ditunjukkan oleh pakar NLU Walid Saba , kami tidak mengatakan:

Charles, yang merupakan seorang dewasa muda yang masih hidup dan lulus dari sekolah pascasarjana, keluar dari sekolah pascasarjana untuk bergabung dengan perusahaan perangkat lunak untuk mencari karyawan baru.

Kami membuatnya lebih sederhana:

Charles putus sekolah pascasarjana untuk bekerja di perusahaan perangkat lunak

dan kami berasumsi bahwa lawan bicara kami sudah mengetahui:

- Anda harus masih hidup untuk bersekolah atau bergabung dengan perusahaan.

- Anda harus menjadi di sekolah pascasarjana untuk berhenti.

- Perusahaan harus memiliki posisi terbuka untuk menutupnya.

Dll Semua ucapan manusia seperti ini, diisi dengan aturan akal sehat yang tidak terlihat yang tidak pernah kami nyatakan secara eksplisit. Jadi, akal sehat dapat dibandingkan dengan materi gelap dalam fisika: ia tidak terlihat, tetapi membentuk sebagian besar.

Jadi bagaimana, kemudian, mesin dapat diajarkan akal sehat buatan? Bagaimana mereka bisa tahu bahwa kita melempar korek api karena kita ingin menyalakan api?

Akal Sehat Buatan: Metode Brute Force

Ada alasan untuk percaya bahwa kita dapat menggunakan kekerasan dalam akal sehat buatan, dan alasan tersebut adalah kemiringan kurva pada grafik berikut:

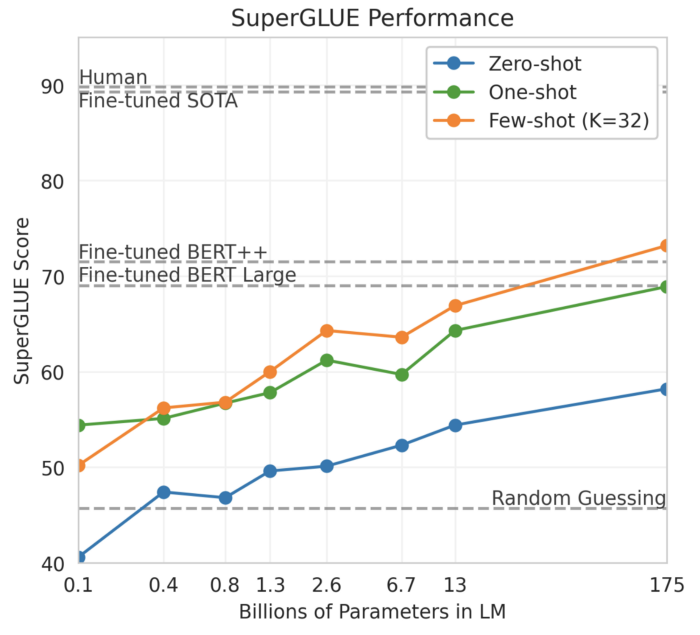

Kinerja GPT-3 pada SuperGLUE

Grafik dari karya GPT-3 " Model Bahasa FSL " menunjukkan kinerja model SuperGLUE sebagai fungsi dari jumlah parameter model, dengan model GPT-3 lengkap di paling kanan. SuperGLUE berisi beberapa tugas semantik yang cukup rumit, seperti skema Winograd:

Trofi tidak muat di koper coklat karena terlalu kecil.

Apa yang terlalu sedikit?

Jawabannya adalah koper.

Patut dicatat bahwa pada 175 miliar parameter, kurva masih berkembang: titik maksimum belum tercapai. Jadi satu hipotesis adalah bahwa kita harus dapat membangun model yang lebih besar dengan triliunan atau lebih parameter dan akhirnya akal sehat buatan akan muncul. Mari kita sebut asumsi ini sebagai hipotesis "kekerasan".

Namun, ini hanyalah hipotesis, dan kami tidak tahu apakah itu benar atau tidak. Argumen balasan di sini adalah bahwa mesin tidak dapat belajar dari sesuatu yang tidak dinyatakan secara eksplisit.

Aturan tak berujung

Jika kita ingin mengajarkan akal sehat kepada mesin, mengapa tidak menuliskan semuanya sebagai aturan dan kemudian meneruskan aturan tersebut ke mesin? Inilah tepatnya yang ingin dilakukan Douglas Lenat pada tahun 1980-an. Dia mempekerjakan ilmuwan komputer dan filsuf untuk menciptakan basis pengetahuan akal sehat yang sekarang dikenal sebagai Cyc. Cyc hari ini berisi 15 juta aturan, seperti:

1. Seekor kelelawar memiliki sayap.

2. Karena memiliki sayap, kelelawar bisa terbang.

3. Karena kelelawar dapat terbang, kelelawar dapat berpindah dari satu tempat ke tempat lain.

Masalah dengan sistem hardcode seperti Cyc adalah aturannya tidak terbatas: untuk setiap aturan ada pengecualian, pengecualian dari pengecualian, dan seterusnya. Karena kelelawar memiliki sayap, ia dapat terbang, kecuali jika sayapnya patah. Perulangan tanpa akhir ini membuat seperangkat aturan menjadi semakin kompleks, sehingga lebih sulit bagi manusia untuk memelihara memori mesin, dan bagi mesin untuk memeliharanya.

Jadi tidak mengherankan bahwa meskipun telah berusaha selama beberapa dekade, Cyc masih tidak berfungsi dan mungkin tidak pernah berhasil. Profesor Pedro Domingos dari Universitas Washington menyebut Cyc sebagai "kegagalan terbesar dalam sejarah kecerdasan buatan." Oren Etzioni, CEO Allen Institute for Artificial Intelligence, kritikus lainnya, berkomentar dalam sebuah wawancara dengan Wired: "Jika berhasil, orang akan tahu itu berhasil."

Mari kita rangkum. Untuk AI "nyata", kita perlu membuat akal sehat buatan. Tapi ada argumen kuat yang menentang hipotesis brute force. Di sisi lain, ada argumen kuat yang menentang aturan hardcode. Bagaimana jika kita menggabungkan yang terbaik dalam pendekatan ini?

Pendekatan hibrida

Perkenalkan COMET , model berbasis transformator yang dikembangkan oleh profesor Universitas Washington Yejin Choi dan kolaboratornya. Inti dari model ini adalah bahwa ia belajar pada basis pengetahuan "benih" dari akal sehat, dan kemudian memperluas basis ini, menghasilkan aturan baru berdasarkan setiap pernyataan baru. Jadi, COMET adalah cara untuk "memuat" akal sehat buatan. Dalam artikel mereka, para peneliti menulis bahwa COMET "sering memberikan pengetahuan akal sehat baru yang diyakini oleh para evaluator benar."

Sebagai ujian, saya mengetik teks: "Gary meletakkan kayu bakar dan batang kayu di perapian, lalu melempar beberapa korek api" ke dalam COMET API , dan berikut adalah bagian dari grafik keluaran:

Beberapa grafik

kesimpulan COMET tentang akal sehat COMET dengan tepat menyimpulkan bahwa Gary * ingin * menyalakan api. Sistem juga menunjukkan bahwa "menjadi hangat karena Gary". Ini terdengar jauh lebih baik daripada jawaban GPT-3 untuk permintaan yang sama menurut saya.

Jadi, apakah COMET merupakan solusi untuk masalah akal sehat buatan? Ini masih harus dilihat. Jika, misalnya, COMET mencapai kinerja tingkat manusia di SuperGLUE, niscaya akan menjadi terobosan baru di lapangan.

Di sisi lain, kritikus mungkin berpendapat bahwa akal sehat tidak dapat diukur dengan kumpulan data referensi buatan. Ada risiko bahwa, setelah membuat kumpulan data tolok ukur seperti itu, peneliti pada suatu saat akan mulai melatih ulang model, membuat hasil tolok ukur menjadi tidak berarti. Salah satu pemikirannya adalah menguji AI dengan tes kecerdasan yang sama dengan manusia. Misalnya, peneliti Stellan Olsson dan staf di University of Illinois di Chicago menyarankan pengujian akal sehat buatan menggunakan tes IQ pada anak-anak.

Jangan biarkan AI hari ini membodohi Anda

Terakhir, jangan biarkan AI hari ini membodohi Anda. Melihat kembali artikel GPT-3, saya menyadari bahwa banyak pernyataannya yang dangkal dan digeneralisasikan, seperti di kue keberuntungan:

Penting untuk tetap berpikiran terbuka dan mencoba hal-hal baru.

Dan kedangkalan ini mungkin adalah alasan mengapa begitu banyak orang bisa tertipu. Bagaimanapun, kedangkalan menyembunyikan kurangnya pemahaman yang benar.

Profesi dan kursus lainnya