Selama beberapa tahun terakhir, kemajuan signifikan telah dibuat di bidang pemrosesan bahasa alami (NLP) , di mana model seperti BERT , ALBERT , ELECTRA, dan XLNet telah mencapai akurasi luar biasa dalam berbagai tugas. Selama pra-pelatihan , representasi vektor dibentuk berdasarkan kumpulan teks yang ekstensif (misalnya, Wikipedia ), yang diperoleh dengan menutupi kata-kata dan mencoba memprediksinya (disebut pemodelan bahasa bertopeng). Representasi yang dihasilkan menyandikan sejumlah besar informasi tentang bahasa dan hubungan antar konsep, seperti antara ahli bedah dan pisau bedah. Kemudian tahap kedua pelatihan dimulai - penyempurnaan - di mana model menggunakan data yang dipertajam untuk tugas tertentu guna mempelajari cara melakukan tugas tertentu seperti klasifikasi menggunakan representasi terlatih umum . Mengingat penggunaan model tersebut secara luas dalam berbagai masalah NLP, penting untuk memahami informasi apa yang dikandungnya dan bagaimana hubungan yang dipelajari memengaruhi hasil model dalam aplikasinya untuk memastikan bahwa model tersebut mematuhi Prinsip Artificial Intelligence (AI) .

Artikel " Mengukur korelasi gender dalam model NLP yang dilatih sebelumnya " mengeksplorasi model BERT dan ALBERT sepupu ringannya dalam mencari hubungan terkait gender, dan merumuskan sejumlah praktik terbaik untuk menggunakan model bahasa yang telah dilatih sebelumnya. Penulis menyajikan hasil eksperimental dalam bentuk bobot model publik dan kumpulan data eksplorasi untuk mendemonstrasikan penerapan praktik terbaik dan memberikan dasar untuk penyelidikan lebih lanjut tentang parameter, yang berada di luar cakupan makalah ini. Selain itu, penulis berencana untuk menyusun satu set bobot Zari , yang mengurangi jumlah korelasi gender, tetapi tetap mempertahankan kualitas tinggi pada masalah NLP standar.

Mengukur korelasi

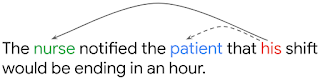

, , , . , . , , his («») nurse ( «»), patient («»).

– OntoNotes (Hovy et al., 2006). F1-, ( Tenney et al. 2019). OntoNotes , WinoGender, , , . ( 1) WinoGender , (.. nurse , ). , , , - , .

BERT ALBERT OntoNotes () WinoGender ( ). WinoGender , , .

, (Large) BERT, ALBERT WinoGender, ( 100%) (accuracy) OntoNotes. , . : , . , .. , , , , .

: NLP- ?

- : , , , . , BERT ALBERT 1% , 26% . : , WinoGender , , , , , , (male nurse).

- : , . , , , , . , , - (dropout regularization), : (dropout rate) BERT ALBERT, . , , , .

- : : , , WinoGender - . , OntoNotes ( BERT'), , - , . (. ).

, NLP-, . , . , , , , . , , , .

- — Kellie Webster

- Terjemahan - Ekaterina Smirnova

- Pengeditan dan tata letak - Sergey Shkarin