Tugas membangun platform TI untuk akumulasi dan analisis data cepat atau lambat muncul untuk perusahaan mana pun yang bisnisnya didasarkan pada model penyampaian layanan yang dimuat secara intelektual atau pembuatan produk yang secara teknis kompleks. Membangun platform analitik adalah tugas yang sulit dan memakan waktu. Namun, tugas apa pun dapat disederhanakan. Pada artikel ini, saya ingin berbagi pengalaman saya menggunakan alat kode rendah untuk membantu Anda membuat solusi analitis. Pengalaman ini diperoleh selama implementasi sejumlah proyek dalam arahan Big Data Solutions dari perusahaan Neoflex. Sejak tahun 2005, departemen Big Data Solutions dari Neoflex telah menangani masalah pembangunan gudang data dan danau, memecahkan masalah dalam mengoptimalkan kecepatan pemrosesan informasi dan mengerjakan metodologi untuk mengelola kualitas data.

Tidak ada yang bisa menghindari akumulasi data yang lemah dan / atau sangat terstruktur. Mungkin bahkan jika kita berbicara tentang bisnis kecil. Memang, saat menskalakan bisnis, wirausahawan yang menjanjikan akan menghadapi masalah pengembangan program loyalitas, ingin menganalisis keefektifan tempat penjualan, memikirkan iklan yang ditargetkan, dan bingung dengan permintaan produk yang menyertainya. Sebagai perkiraan pertama, masalah bisa diselesaikan dengan lutut. Tetapi dengan pertumbuhan bisnis, datang ke platform analitik masih tidak bisa dihindari.

Namun, dalam hal apa tugas analitik data dapat berkembang menjadi tugas kelas "Sains Roket"? Mungkin pada saat itu ketika datang ke data yang sangat besar.

Untuk menyederhanakan tugas Ilmu Roket, Anda bisa memakan gajah sepotong demi sepotong.

Semakin banyak kebijaksanaan dan otonomi yang dimiliki aplikasi / layanan / layanan mikro Anda, semakin mudah bagi Anda, kolega, dan seluruh bisnis untuk mencerna seekor gajah.

Hampir semua klien kami mengikuti postulat ini, membangun kembali lanskap, berdasarkan praktik teknik tim DevOps.

Tetapi bahkan dengan pola makan "split, elephant", kami memiliki peluang bagus untuk "oversaturation" pada lanskap TI. Pada titik ini, ada baiknya berhenti, menghembuskan napas, dan melihat ke platform rekayasa kode rendah .

Banyak pengembang diintimidasi oleh prospek kebuntuan dalam karier mereka saat beralih dari penulisan kode langsung ke panah "menyeret" di antarmuka UI sistem kode rendah. Tetapi kemunculan peralatan mesin tidak menyebabkan hilangnya insinyur, tetapi membawa pekerjaan mereka ke tingkat yang baru!

Mari kita cari tahu alasannya.

Analisis data di bidang logistik, industri telekomunikasi, di bidang penelitian media, bidang keuangan, selalu dikaitkan dengan pertanyaan-pertanyaan berikut:

- Kecepatan analisis otomatis;

- Kemampuan untuk melakukan eksperimen tanpa mempengaruhi aliran utama produksi data;

- Keandalan data yang disiapkan;

- Melacak perubahan dan pembuatan versi;

- Pembuktian data, Garis keturunan, CDC;

- Pengiriman cepat fitur baru ke lingkungan produksi;

- Dan pepatah: biaya pengembangan dan dukungan.

Artinya, insinyur memiliki sejumlah besar tugas tingkat tinggi, yang dapat dilakukan dengan efisiensi yang memadai hanya dengan menjernihkan pikiran mereka dari tugas pengembangan tingkat rendah.

Evolusi dan digitalisasi bisnis menjadi prasyarat transisi pengembang ke level baru. Nilai pengembang juga berubah: ada kekurangan pengembang yang dapat mendalami konsep bisnis otomatis.

Mari kita membuat analogi dengan bahasa pemrograman tingkat rendah dan tingkat tinggi. Transisi dari bahasa tingkat rendah menuju bahasa tingkat tinggi adalah transisi dari menulis "petunjuk langsung dalam bahasa besi" ke "petunjuk dalam bahasa manusia". Artinya, menambahkan beberapa lapisan abstraksi. Dalam kasus ini, transisi ke platform kode rendah dari bahasa pemrograman tingkat tinggi merupakan transisi dari "perintah dalam bahasa orang" ke "perintah dalam bahasa bisnis". Jika ada developer yang sedih dengan fakta ini, maka mereka sedih, bahkan mungkin sejak Java Script lahir, yang menggunakan fungsi penyortiran array. Dan fungsi-fungsi ini, tentu saja, memiliki implementasi perangkat lunak di bawah tenda dengan cara lain dari pemrograman tingkat tinggi yang sama.

Oleh karena itu, kode rendah hanyalah kemunculan lapisan abstraksi lainnya.

Pengalaman terapan menggunakan kode rendah

Topik kode rendah cukup luas, tetapi sekarang saya ingin berbicara tentang penerapan terapan "konsep kode rendah" menggunakan contoh salah satu proyek kami.

Divisi Big Data Solutions dari perusahaan Neoflex berspesialisasi lebih luas dalam sektor keuangan bisnis, membangun penyimpanan dan data lake, serta mengotomatiskan berbagai pelaporan. Di ceruk ini, penggunaan kode rendah telah lama menjadi standar. Alat kode rendah lainnya termasuk alat untuk mengatur proses ETL: Informatica Power Center, IBM Datastage, Pentaho Data Integration. Atau Oracle Apex, yang bertindak sebagai lingkungan untuk pengembangan antarmuka yang cepat untuk mengakses dan mengedit data. Namun, penggunaan alat pengembangan kode rendah tidak selalu dikaitkan dengan pembangunan aplikasi yang sangat bertarget pada tumpukan teknologi komersial dengan ketergantungan vendor yang jelas.

Dengan menggunakan platform kode rendah, Anda juga dapat mengatur orkestrasi aliran data, membuat platform ilmu data, atau, misalnya, modul kontrol kualitas data.

Salah satu contoh terapan dari pengalaman menggunakan alat pengembangan kode rendah adalah kolaborasi antara Neoflex dan Mediascope, salah satu pemimpin di pasar penelitian media Rusia. Salah satu tujuan bisnis perusahaan ini adalah produksi data, yang menjadi dasar pengiklan, situs Internet, saluran TV, stasiun radio, biro iklan, dan merek memutuskan untuk membeli iklan dan merencanakan komunikasi pemasaran mereka.

Riset media adalah area bisnis padat teknologi. Mengenali urutan video, mengumpulkan data dari perangkat yang menganalisis tampilan, mengukur aktivitas di sumber daya web - semua ini menyiratkan bahwa perusahaan memiliki staf TI yang besar dan pengalaman luar biasa dalam membangun solusi analitis. Namun pertumbuhan eksponensial jumlah informasi, jumlah dan ragam sumbernya membuat industri data TI terus berkembang. Solusi paling sederhana untuk menskalakan platform analitik yang sudah berfungsi Mediascope adalah peningkatan staf TI. Tetapi solusi yang jauh lebih efisien adalah mempercepat proses pengembangan. Salah satu langkah yang mengarah ke arah ini mungkin penggunaan platform kode rendah.

Pada saat dimulainya proyek, perusahaan sudah memiliki solusi produk yang berfungsi. Namun, implementasi solusi di MSSQL tidak dapat sepenuhnya memenuhi harapan untuk menskalakan fungsionalitas sambil mempertahankan biaya revisi yang dapat diterima.

Tugas di hadapan kami benar-benar ambisius - Neoflex dan Mediascope harus membuat solusi industri dalam waktu kurang dari setahun, asalkan MVP dirilis dalam kuartal pertama tanggal mulai.

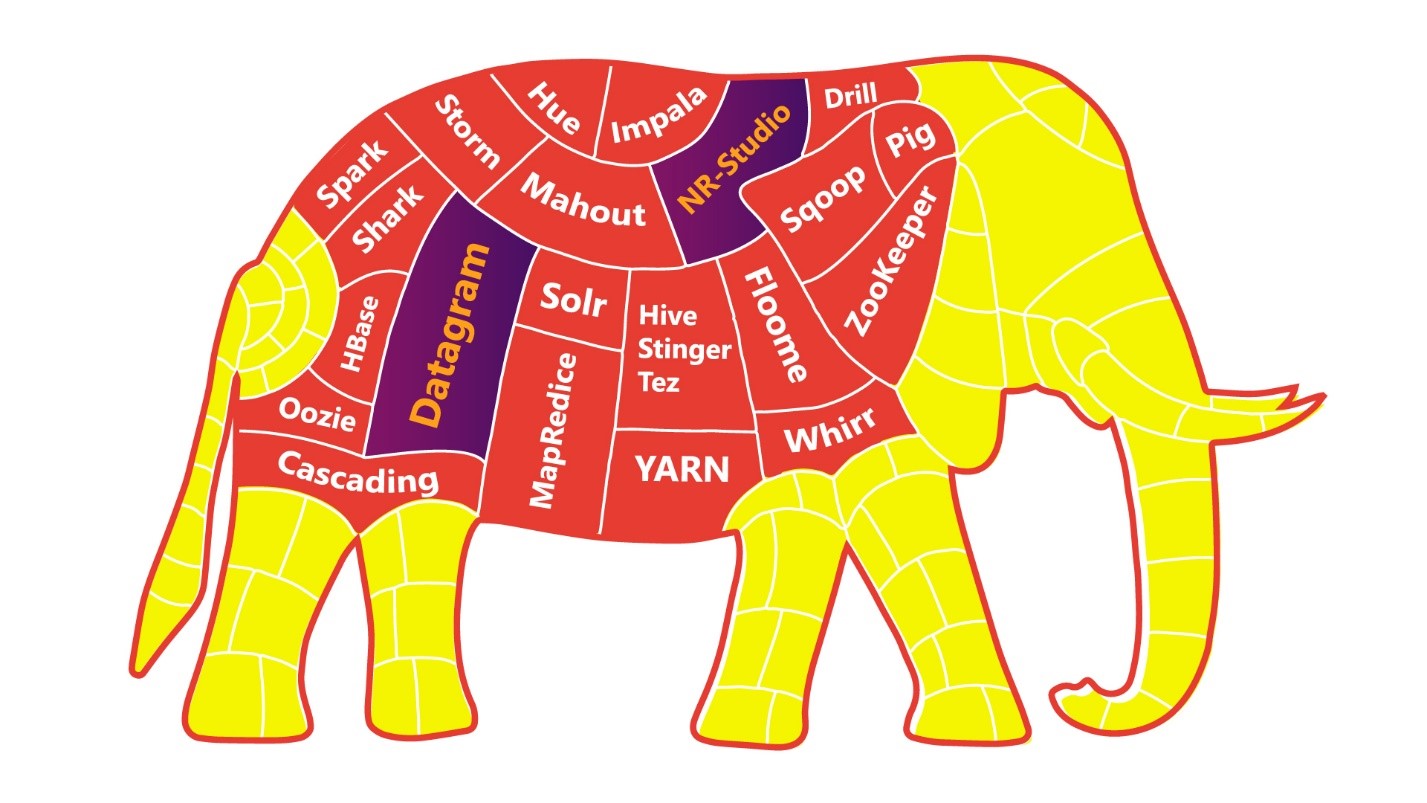

Tumpukan teknologi Hadoop dipilih sebagai dasar untuk membangun platform data baru berdasarkan komputasi kode rendah. HDFS telah menjadi standar penyimpanan data dengan menggunakan file parket. Untuk mengakses data di platform, Hive digunakan, di mana semua etalase yang tersedia disajikan sebagai tabel eksternal. Memuat data ke penyimpanan diimplementasikan menggunakan Kafka dan Apache NiFi.

Alat kode-rendah dalam konsep ini digunakan untuk mengoptimalkan tugas yang paling padat karya dalam membangun platform analitis - tugas menghitung data.

Alat Datagram kode rendah dipilih sebagai mekanisme utama untuk pemetaan data. Neoflex Datagram adalah alat untuk mendesain transformasi dan aliran data.

Dengan menggunakan alat ini, Anda dapat menghindari penulisan kode Scala "dengan tangan". Kode skala dibuat secara otomatis menggunakan pendekatan Arsitektur Berbasis Model.

Nilai tambah yang jelas dari pendekatan ini adalah percepatan proses pembangunan. Namun, selain kecepatan, ada juga keunggulannya sebagai berikut:

- Melihat konten dan struktur sumber / tujuan;

- Melacak asal-usul objek aliran data ke bidang individu (garis keturunan);

- Eksekusi sebagian transformasi dengan melihat hasil antara;

- Melihat kode sumber dan memperbaikinya sebelum eksekusi;

- Validasi otomatis transformasi;

- Pemuatan data otomatis 1 in 1.

Ambang batas untuk memasukkan solusi kode rendah untuk menghasilkan transformasi cukup rendah: pengembang perlu mengetahui SQL dan memiliki pengalaman dengan alat ETL. Perlu dicatat bahwa generator transformasi berbasis kode bukanlah alat ETL dalam arti luas kata tersebut. Alat kode rendah mungkin tidak memiliki lingkungan eksekusi kodenya sendiri. Artinya, kode yang dihasilkan akan dijalankan di lingkungan yang ada di cluster bahkan sebelum penginstalan solusi kode rendah. Dan ini, mungkin, merupakan nilai tambah lainnya dalam karma kode rendah. Karena, secara paralel dengan perintah kode-rendah, perintah "klasik" dapat bekerja, yang mengimplementasikan fungsionalitas, misalnya, dalam kode-Scala murni. Menarik pekerjaan kedua tim ke dalam produksi akan menjadi sederhana dan mulus.

Mungkin perlu dicatat bahwa selain kode rendah, ada juga solusi tanpa kode. Dan pada intinya mereka adalah hal yang berbeda. Kode rendah memungkinkan pengembang untuk lebih mengganggu kode yang dihasilkan. Dalam kasus Datagram, dimungkinkan untuk melihat dan mengedit kode Scala yang dihasilkan, tanpa kode mungkin tidak memberikan kesempatan seperti itu. Perbedaan ini sangat signifikan tidak hanya dalam hal fleksibilitas solusi, tetapi juga dalam hal kenyamanan dan motivasi dalam pekerjaan insinyur data.

Arsitektur solusi

Mari kita coba mencari tahu bagaimana tepatnya alat kode rendah membantu memecahkan masalah pengoptimalan kecepatan pengembangan fungsionalitas penghitungan data. Pertama, mari kita lihat arsitektur fungsional sistem. Dalam hal ini, contohnya adalah model produksi data untuk penelitian media.

Sumber data dalam kasus kami sangat heterogen dan beragam:

- (-) — - , – , , . – . Data Lake , , , . , , ;

- ;

- web-, site-centric, user-centric . Data Lake research bar VPN.

- , - ;

- -.

Seperti implementasi pemuatan dari sistem sumber ke pementasan primer data mentah dapat diatur dengan berbagai cara. Jika kode rendah digunakan untuk tujuan ini, dimungkinkan untuk secara otomatis menghasilkan skrip pemuatan berdasarkan metadata. Dalam hal ini, tidak perlu turun ke tingkat pengembangan sumber ke pemetaan target. Untuk mengimplementasikan pemuatan otomatis, kita perlu membuat koneksi dengan sumber, dan kemudian menentukan dalam antarmuka pemuatan daftar entitas yang akan dimuat. Pembuatan struktur direktori di HDFS akan dilakukan secara otomatis dan akan sesuai dengan struktur penyimpanan data di sistem sumber.

Namun, dalam konteks proyek ini, kami memutuskan untuk tidak menggunakan peluang platform kode rendah ini karena fakta bahwa Mediascope telah secara mandiri mulai mengerjakan produksi layanan serupa di tautan Nifi + Kafka.

Perlu dicatat segera bahwa alat-alat ini tidak dapat saling dipertukarkan, melainkan saling melengkapi. Nifi dan Kafka mampu bekerja baik dalam bundel langsung (Nifi -> Kafka) dan sebaliknya (Kafka -> Nifi). Untuk platform penelitian media, tautan pertama digunakan.

Dalam kasus kami, saya perlu memproses berbagai jenis data dari sistem sumber dan mengirimkannya ke broker Kafka. Pada saat yang sama, pengarahan pesan ke topik Kafka tertentu dilakukan dengan menggunakan prosesor PublishKafka Nifi. Orkestrasi dan pemeliharaan pipeline ini dilakukan dalam antarmuka visual. Alat Nifi dan penggunaan bundel Nifi + Kafka juga dapat disebut sebagai pendekatan kode rendah untuk pengembangan, yang memiliki ambang batas rendah untuk masuk ke teknologi Big Data dan mempercepat proses pengembangan aplikasi.

Tahap selanjutnya dalam implementasi proyek adalah reduksi ke format satu lapisan semantik data terperinci. Jika entitas memiliki atribut historis, penghitungan dilakukan dalam konteks partisi yang dimaksud. Jika entitas tersebut tidak bersifat historis, maka secara opsional dimungkinkan untuk menghitung ulang seluruh konten objek, atau menolak untuk menghitung ulang objek ini sama sekali (karena tidak adanya perubahan). Pada tahap ini, kunci dibuat untuk semua entitas. Kunci disimpan dalam direktori Hbase yang sesuai dengan objek master, berisi korespondensi antara kunci dalam platform analitik dan kunci dari sistem sumber. Konsolidasi entitas atom disertai dengan pengayaan dengan hasil perhitungan awal data analitik. Kerangka untuk menghitung data adalah Spark.Fungsionalitas yang dijelaskan untuk mengubah data menjadi semantik tunggal juga diimplementasikan atas dasar pemetaan alat kode rendah Datagram.

Arsitektur target diperlukan untuk menyediakan akses data SQL untuk pengguna bisnis. Sarang digunakan untuk opsi ini. Objek didaftarkan di Hive secara otomatis saat opsi "Registr Hive Table" diaktifkan di alat kode rendah.

Kontrol arus pembayaran

Datagram memiliki antarmuka untuk membangun desain alur kerja. Pemetaan dapat diluncurkan menggunakan penjadwal Oozie. Dalam antarmuka pengembang aliran, dimungkinkan untuk membuat skema paralel, sekuensial atau tergantung pada kondisi yang ditentukan untuk pelaksanaan transformasi data. Ada dukungan untuk skrip shell dan program java. Juga dimungkinkan untuk menggunakan server Apache Livy. Apache Livy digunakan untuk menjalankan aplikasi langsung dari lingkungan pengembangan.

Jika perusahaan sudah memiliki orkestrator prosesnya sendiri, REST API dapat digunakan untuk menyematkan pemetaan ke dalam aliran yang ada. Misalnya, kami memiliki pengalaman yang cukup berhasil dalam menyematkan pemetaan Scala ke dalam orkestra yang ditulis dalam PLSQL dan Kotlin. REST API dari alat kode rendah menyiratkan adanya operasi seperti menghasilkan tahun yang dapat dieksekusi berdasarkan desain pemetaan, memanggil pemetaan, memanggil urutan pemetaan dan, tentu saja, meneruskan parameter ke URL untuk meluncurkan pemetaan.

Bersama dengan Oozie, dimungkinkan untuk mengatur aliran perhitungan menggunakan Aliran Udara. Mungkin saya tidak akan memikirkan perbandingan Oozie dan Airflow untuk waktu yang lama, tetapi saya hanya akan mengatakan bahwa dalam konteks pekerjaan pada proyek penelitian media, pilihannya jatuh ke Airflow. Argumen utama kali ini ternyata adalah komunitas yang lebih aktif mengembangkan produk dan antarmuka + API yang lebih berkembang.

Aliran udara juga bagus karena menggunakan Python tercinta untuk menjelaskan proses penghitungan. Secara umum, tidak banyak platform pengelolaan alur kerja open source. Meluncurkan dan memantau pelaksanaan proses (termasuk yang memiliki bagan Gantt) hanya menambahkan poin ke karma Airflow.

Format file konfigurasi untuk meluncurkan pemetaan solusi kode rendah adalah spark-submit. Ini terjadi karena dua alasan. Pertama, spark-submit memungkinkan Anda menjalankan file jar langsung dari konsol. Kedua, ini dapat berisi semua informasi yang Anda butuhkan untuk mengkonfigurasi alur kerja (membuatnya lebih mudah untuk menulis skrip yang membentuk Dag).

Elemen paling umum dari alur kerja Aliran Udara dalam kasus kami adalah SparkSubmitOperator.

SparkSubmitOperator memungkinkan Anda menjalankan jar`niks - pemetaan Datagram yang dikemas dengan parameter masukan yang telah dibentuk sebelumnya untuk mereka.

Perlu disebutkan bahwa setiap tugas Aliran Udara berjalan pada utas terpisah dan tidak mengetahui apa pun tentang tugas lainnya. Dalam hubungan ini, interaksi antar tugas dilakukan dengan menggunakan operator kontrol, seperti DummyOperator atau BranchPythonOperator.

Secara agregat, penggunaan solusi kode-rendah Datagram dalam hubungannya dengan universalisasi file konfigurasi (membentuk Dag) telah menyebabkan percepatan dan penyederhanaan yang signifikan dari proses pengembangan aliran unduhan data.

Perhitungan showcase

Mungkin tahap yang paling cerdas dimuat dalam produksi data analitis adalah langkah pembuatan etalase. Dalam konteks salah satu arus data perusahaan riset, pada tahap ini dilakukan konversi menjadi siaran referensi, dengan memperhatikan koreksi zona waktu dengan mengacu pada grid penyiaran. Dimungkinkan juga untuk menyesuaikan dengan jaringan penyiaran lokal (berita dan iklan lokal). Antara lain, langkah ini memecah interval penayangan produk media secara terus menerus berdasarkan analisis interval penayangan. Segera, nilai tampilan "diberi bobot" berdasarkan informasi tentang signifikansinya (penghitungan faktor koreksi).

Validasi data adalah langkah terpisah dalam mempersiapkan data mart. Algoritma validasi menggunakan sejumlah model ilmu matematika. Namun, penggunaan platform kode rendah memungkinkan algoritme kompleks dipecah menjadi sejumlah pemetaan terpisah yang dapat dibaca secara visual. Setiap pemetaan melakukan tugas yang sempit. Akibatnya, proses debugging, logging, dan visualisasi tahap persiapan data dapat dilakukan.

Diputuskan untuk mendiskritkan algoritme validasi ke dalam sub-tahap berikut:

- Merencanakan regresi ketergantungan menonton jaringan televisi di suatu wilayah dengan menonton semua jaringan di wilayah tersebut selama 60 hari.

- Perhitungan residual pelajar (penyimpangan nilai aktual dari yang diprediksi oleh model regresi) untuk semua titik regresi dan untuk hari yang dihitung.

- Sampel pasangan wilayah-jaringan yang tidak wajar, dengan sisa pelajar dari hari yang dihitung melebihi norma (ditentukan oleh setelan operasi).

- Penghitungan ulang sisa siswa yang dikoreksi untuk pasangan wilayah-jaringan yang tidak wajar untuk setiap responden yang melihat jaringan di wilayah tersebut dengan penentuan kontribusi responden ini (nilai perubahan dalam sisa siswa yang disisihkan) ketika responden ini dikeluarkan dari sampel.

- Mencari kandidat, dengan pengecualian yang membuat saldo pelajar pada hari penyelesaian kembali normal.

Contoh di atas adalah konfirmasi dari hipotesis bahwa seorang data engineer seharusnya memiliki terlalu banyak pemikiran ... Dan jika ini benar-benar seorang "insinyur", bukan "pembuat kode", maka ketakutan akan degradasi profesional saat menggunakan alat kode rendah dia akhirnya harus mundur.

Apa lagi yang bisa dilakukan kode rendah?

Cakupan alat kode rendah untuk pengelompokan dan streaming data tanpa menulis kode Scala secara manual tidak berakhir di sana.

Penggunaan low-code dalam pengembangan datalakes sudah menjadi standar bagi kami. Mungkin kita dapat mengatakan bahwa solusi pada tumpukan Hadoop mengikuti jalur pengembangan DWH klasik berdasarkan RDBMS. Alat kode rendah pada tumpukan Hadoop dapat menyelesaikan tugas pemrosesan data dan tugas membangun antarmuka BI akhir. Selain itu, perlu dicatat bahwa BI tidak hanya dapat berarti representasi data, tetapi juga pengeditannya oleh kekuatan pengguna bisnis. Kami sering menggunakan fungsi ini saat membangun platform analitik untuk sektor keuangan.

Antara lain, menggunakan kode rendah dan, khususnya, Datagram, adalah mungkin untuk memecahkan masalah penelusuran asal objek aliran data dengan atomicity ke bidang individu (garis keturunan). Untuk melakukan ini, alat kode rendah mengimplementasikan antarmuka dengan Apache Atlas dan Cloudera Navigator. Faktanya, pengembang perlu mendaftarkan sekumpulan objek di kamus Atlas dan merujuk ke objek terdaftar saat membuat pemetaan. Mekanisme untuk melacak asal data atau menganalisis dependensi objek menghemat banyak waktu jika diperlukan untuk melakukan perbaikan pada algoritme penghitungan. Misalnya, saat menyusun laporan keuangan, fitur ini memungkinkan Anda untuk lebih nyaman bertahan dalam periode perubahan legislatif. Bagaimanapun, semakin baik kita memahami ketergantungan antar-bentuk dalam konteks objek lapisan terperinci,semakin sedikit kita akan menemukan cacat "mendadak" dan mengurangi jumlah pengerjaan ulang.

Kualitas Data & Kode Rendah

Tugas lain yang diterapkan oleh alat kode rendah pada proyek Mediascope adalah tugas kelas Kualitas Data. Salah satu fitur dari implementasi pipeline verifikasi data untuk proyek perusahaan riset adalah kurangnya pengaruhnya terhadap kinerja dan kecepatan aliran data utama. Apache Airflow yang sudah dikenal digunakan untuk mengaktifkan orkestrasi validasi data oleh utas independen. Saat setiap langkah produksi data siap, bagian terpisah dari pipeline DQ diluncurkan secara paralel.

Merupakan praktik yang baik untuk memantau kualitas data dari awal mula di platform analitik. Memiliki informasi tentang metadata, kita dapat, dari saat informasi memasuki lapisan utama, memeriksa apakah kondisi dasar terpenuhi - bukan nol, kendala, kunci asing. Fungsionalitas ini diimplementasikan berdasarkan pemetaan yang dibuat secara otomatis dari keluarga kualitas data di Datagram. Pembuatan kode dalam hal ini juga didasarkan pada metadata model. Pada proyek Mediascope, antarmuka dilakukan dengan metadata produk Enterprise Architect.

Dengan memasangkan alat kode rendah dan Arsitek Perusahaan, pemeriksaan berikut dibuat secara otomatis:

- Memeriksa keberadaan nilai "null" di kolom dengan pengubah "bukan null";

- Memeriksa keberadaan duplikat kunci utama;

- Validasi kunci asing entitas;

- Memeriksa keunikan string terhadap sekumpulan bidang.

Untuk ketersediaan data dan pemeriksaan validitas yang lebih canggih, pemetaan Scala Expression dibuat yang menerima kode pemeriksaan Spark SQL eksternal yang disiapkan oleh analis di Zeppelin.

Tentu saja, perlu untuk datang ke pemeriksaan pembuatan otomatis secara bertahap. Dalam kerangka proyek yang dijelaskan, ini didahului dengan langkah-langkah berikut:

- DQ diimplementasikan di notebook Zeppelin;

- DQ built in mapping;

- DQ dalam bentuk pemetaan masif terpisah berisi seluruh rangkaian pemeriksaan untuk entitas tertentu;

- Pemetaan DQ berparameter universal yang menerima metadata dan informasi validasi bisnis sebagai input.

Mungkin keuntungan utama dari membuat layanan pemeriksaan berparameter adalah pengurangan waktu pengiriman fungsionalitas ke lingkungan produksi. Pemeriksaan kualitas baru dapat melewati pola klasik pengiriman kode secara tidak langsung melalui lingkungan pengembangan dan pengujian:

- Semua pemeriksaan metadata dibuat secara otomatis saat model berubah di EA;

- Pemeriksaan ketersediaan data (menentukan keberadaan data apa pun pada suatu titik waktu) dapat dibuat berdasarkan direktori yang menyimpan waktu yang diharapkan dari kemunculan potongan data berikutnya dalam konteks objek;

- Pemeriksaan masuk akal data bisnis dibuat oleh analis di notebook Zeppelin. Dari mana mereka langsung menuju ke tabel pengaturan modul DQ di lingkungan produksi.

Tidak ada risiko pengiriman langsung skrip ke produksi seperti itu. Bahkan dengan adanya kesalahan sintaks, maksimum yang mengancam kita adalah kegagalan melakukan satu pemeriksaan, karena aliran perhitungan data dan alur peluncuran pemeriksaan kualitas terpisah satu sama lain.

Faktanya, layanan DQ secara permanen berjalan di lingkungan produksi dan siap untuk memulai pekerjaannya saat potongan data berikutnya muncul.

Alih-alih kesimpulan

Keuntungan menggunakan kode rendah sudah jelas. Pengembang tidak perlu mengembangkan aplikasi dari awal. Seorang programmer yang dibebaskan dari tugas tambahan memberikan hasil lebih cepat. Kecepatan, pada gilirannya, membebaskan sumber daya waktu tambahan untuk menyelesaikan masalah pengoptimalan. Oleh karena itu, dalam hal ini, Anda dapat mengandalkan solusi yang lebih baik dan lebih cepat.

Tentu saja, kode rendah bukanlah obat mujarab, dan keajaiban tidak akan terjadi dengan sendirinya:

- Industri kode rendah sedang melalui tahap "tumbuh", dan sejauh ini tidak ada standar industri yang seragam;

- Banyak solusi kode rendah tidak gratis, dan membelinya harus merupakan langkah yang disengaja, yang harus dilakukan dengan keyakinan penuh atas keuntungan finansial dari penggunaannya;

- GIT / SVN. ;

- – , , « » low-code-.

- , low-code-. . / IT- .

Namun, jika Anda mengetahui semua kekurangan dari sistem yang dipilih, dan manfaat dari penggunaannya, bagaimanapun, adalah mayoritas yang dominan, maka buka kode kecil tanpa rasa takut. Selain itu, transisi ke sana tidak dapat dihindari - karena evolusi apa pun tidak dapat dihindari.

Jika satu pengembang pada platform kode rendah dapat melakukan pekerjaan mereka lebih cepat daripada dua pengembang tanpa kode rendah, maka ini memberi perusahaan permulaan dalam segala hal. Ambang batas untuk memasukkan solusi kode rendah lebih rendah daripada di teknologi "tradisional", dan ini memiliki efek positif pada masalah kekurangan staf. Saat menggunakan alat kode rendah, dimungkinkan untuk mempercepat interaksi antara tim fungsional dan membuat keputusan lebih cepat tentang kebenaran jalur penelitian sains data yang dipilih. Platform tingkat rendah dapat mendorong transformasi digital organisasi, karena solusi yang dihasilkan dapat dipahami oleh spesialis non-teknis (khususnya, pengguna bisnis).

Jika Anda memiliki tenggat waktu yang ketat, logika bisnis yang sibuk, kurangnya keahlian teknologi, dan Anda perlu mempercepat waktu untuk memasarkan, maka kode rendah adalah salah satu cara untuk memenuhi kebutuhan Anda.

Tidak dapat disangkal pentingnya alat pengembangan tradisional, tetapi dalam banyak kasus penggunaan solusi kode rendah adalah cara terbaik untuk meningkatkan efisiensi masalah yang dipecahkan.